概要

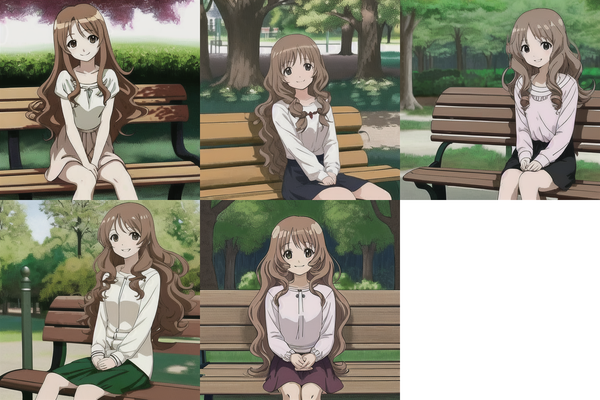

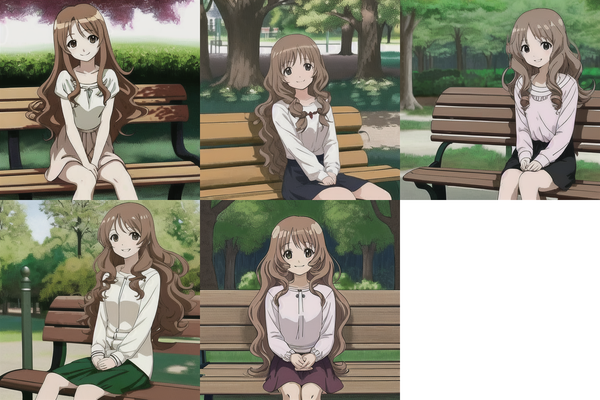

今回は、画像生成モデルStable Diffusionを使って、当ブログの英語の記事で登場するEmiさんのイラストが簡単に生成できるようにしたいと思います。

そのために、LoRAという技術を使います。

LoRA(Low-Rank Adaptation)とは、AIモデルのファインチューニングを効率的に行うための技術です。特に大規模言語モデル(LLM)や画像生成AIの微調整に用いられ、少ない計算資源で高品質なカスタマイズを可能にします。

LoRAは、モデルの重みを直接変更するのではなく、低ランクの行列を挿入して学習することで、従来のファインチューニングよりも少ない計算コストで高い性能を維持できます。

🧠 LoRAの数学的な挿入位置

元の重み W を以下のように拡張します:

W' = W + α * (BA)

A:低ランクの行列(学習する)

B:低ランクの行列(学習する)

α:スケーリング係数(学習時や推論時に設定)

この BA 部分だけが学習され、元の W は固定のままです。

📌 実行時(推論時)の仕組み

LoRAで生成